Wat is LLMO in het kort?

Large Language Model Optimization (LLMO) is het optimaliseren van content, merken en entiteiten zodat ze zichtbaarder en nauwkeuriger worden weergegeven in de output van grote taalmodellen (LLM’s) zoals GPT-4, Claude, Gemini en Llama.

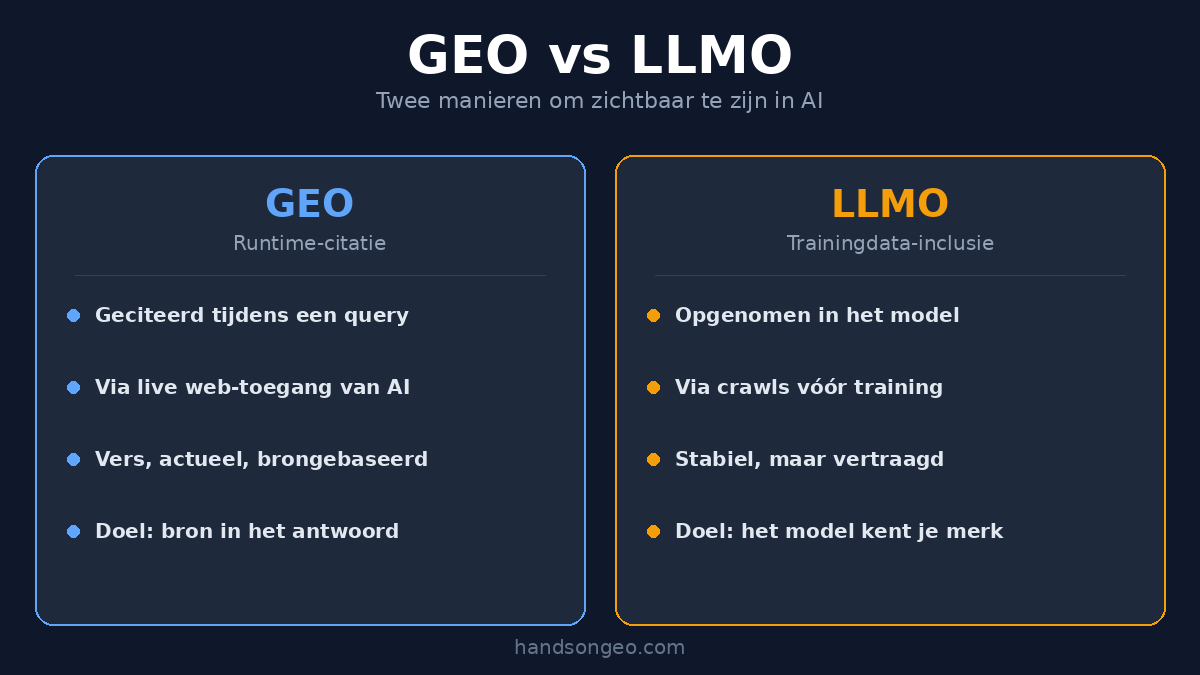

LLMO vs. GEO: verschil in scope

Generative Engine Optimization (GEO) is een onderdeel van LLMO. GEO richt zich specifiek op geciteerd worden als bron in AI-zoekmachines — Perplexity, ChatGPT met browsing, Google AI Overviews. LLMO is breder: het omvat GEO maar ook hoe LLM’s je merk representeren in niet-zoekcontexten, zoals productaanbevelingen, vergelijkingen en algemene kennisvragen.

Als iemand aan ChatGPT vraagt “welk CRM is het beste voor kleine bedrijven” en het jouw product noemt — dat is een LLMO-resultaat. Als iemand aan Perplexity vraagt “wat is e-mail deliverability” en het jouw artikel citeert — dat is een GEO-resultaat. Beide vallen onder LLMO.

Hoe LLM’s bepalen wat ze opnemen

LLM’s genereren antwoorden op basis van twee inputs: hun trainingsdata (wat ze leerden tijdens pre-training) en hun retrievaldata (wat ze in real-time kunnen opvragen via zoeken of browsen).

Invloed van trainingsdata. Modellen leren van grote datasets met webcontent, boeken en andere tekst. Content die frequent en consistent verschijnt op betrouwbare bronnen wordt sterker weerspiegeld in de kennis van het model. Dit is waar entity optimization relevant wordt: een merk dat consistent wordt vermeld op Wikipedia, Wikidata, vakpublicaties en de eigen site bouwt een sterkere representatie op in trainingsdata.

Retrieval-augmented generation (RAG). Nieuwere AI-zoekproducten gebruiken RAG om actuele informatie op te halen op het moment van de vraag. Als Perplexity een vraag beantwoordt, doorzoekt het het web, selecteert relevante passages en synthetiseert die tot een antwoord. Hier hebben GEO-tactieken — bronvermeldingen, statistieken, heldere structuur — direct effect.

Belangrijkste LLMO-strategieen

Consistente entiteitsaanwezigheid. Zorg dat je merk, belangrijke personen en producten consistent worden beschreven op je website, sociale profielen, Wikidata en branchegidsen. LLM’s bouwen entiteitsbegrip op door meerdere bronnen te kruisverwijzen.

Gestructureerde data. Schema-markup (JSON-LD) helpt zowel zoekmachines als AI-crawlers om relaties tussen entiteiten te begrijpen. Een Organization-schema dat linkt naar een Person-schema dat linkt naar gepubliceerde Articles creëert een machineleesbaar web van context.

Content die vragen direct beantwoordt. LLM’s zijn geoptimaliseerd om directe antwoorden te vinden en extraheren. Content die is gestructureerd rond vragen — met heldere, feitelijke antwoorden in de eerste zin van elke sectie — wordt vaker geselecteerd.

Feitdichtheid boven meningen. Onderzoek van Princeton en Georgia Tech toont dat verifieerbare claims met bronnen de AI-citatieratio met tot 40% verhogen (Aggarwal et al., 2023). LLM’s geven de voorkeur aan passages met genoemde datapunten boven passages die meningen geven zonder onderbouwing.

Monitoring en correctie. LLM’s kunnen onjuiste informatie produceren over merken en personen. Regelmatig monitoren wat AI-platformen over je zeggen, gecombineerd met correcties via gepubliceerde content, is een kernpraktijk in LLMO. Dit wordt soms een “hallucination audit” genoemd.

Gerelateerde concepten

- GEO (Generative Engine Optimization) — het onderdeel gericht op citaties in AI-zoekresultaten

- AI Search — de platformen waar GEO-resultaten zichtbaar zijn

- Entity Optimization — herkenbare entiteiten bouwen die LLM’s kunnen identificeren

- Knowledge Graph — de gestructureerde datalaag die entiteiten verbindt

—

Laatst bijgewerkt: maart 2026 | Hands on GEO